AI-teknologi som ChatGPT och DALL-E har väckt intresse och oro i samhället. ChatGPT är en artificiell intelligens som kan förstå och generera text och DALL-E är en liknande teknik som kan generera bilder. Men vad innebär egentligen dessa tekniker och hur påverkar de oss? I ett samtal mellan H och K diskuteras fördelar och risker med dessa verktyg, samt behovet av AI-litteracitet och källkritik.

H: Hej K! Jag tänkte att vi kunde prata om ChatGPT och DALL-E. Mio bad mig att förklara vad det är på ett sätt som folk förstår.

K: Ja, det kan vi göra.

H: Om vi börjar här: vad är egentligen ChatGPT-, alltså Chat Generative Pre-trained Transformer? Det är en artificiell intelligens som är tränad på att förstå och generera text, alltså ett slags chatbot. Teknologin har existerat i många år men inte varit tillgänglig för den breda allmänheten förrän nu. Jag upplevde att den allmänna diskussionen i början utgick från att det här kommer att förändra allt, kanske till det sämre. Men nu verkar folk ha lugnat sig lite.

Hot eller möjlighet?

K: Inom våra fält, kultur och vetenskap, tycks man oroa sig för påverkan av sådana här verktyg, eller har i bästa fall en kritisk och nyanserad diskussion, men när man använder AI inom andra sammanhang, som Google Sök eller sociala medier, så är man helt obrydd. Inom utbildning finns en oro för fusk men vi kanske snarare borde tänka på hur vi kan använda ChatGPT i examinationer istället för att återgå till handskrivna tentor.

H: Jag tänker också att frågan om det är ett hot eller en möjlighet är fel ställd; det är väl både och. Kanske måste vi istället fundera på hur vi kan minimera hotet och främja möjligheterna. Om man till exempel ber ChatGPT skriva en litteraturöversikt så gör den det, men alla källor är påhittade. Och ja, det är väldigt problematiskt, men problemet är också att folk tror att den kan användas till det syftet.

K: Ja, det behövs både källkritik och en förståelse för användningsområdena, så jag tror att en större AI-litteracitet kommer vara helt nödvändigt för alla som på olika sätt stöter på AI och ChatGPT i sin vardag. Inte bara för att förstå hur man själv kan använda en chatbot utan för en vidare förståelse av fenomenet. Textgeneratorer gör det till exempel mycket lättare att generera falska nyheter som kan dränka all annan information. Utöver källkritik behöver man därför också kunna söka och sålla i information, vilket ibland kan vara som att hitta en nål i en höstack. AI-genererade nonsenstexter om personer kan snabbt gå från kul skämt till förtal, och vad händer i detta sammanhang med rätten att bli bortglömd, alltså rätten att få dina personuppgifter raderade från de som lagrar dem eller att slippa synas i sökresultat. Kan en språkmodell glömma något den strängt taget inte vet? Det finns en etisk aspekt här som går bortom för eller mot, hot eller möjlighet, skepsis eller leklust – FN varnar för den, EU försöker reglera den, men diskussionerna strandar ofta i teknooptimism eller teknoalarmism.

Avancerade verktyg kräver avancerad kunskap

H: Jag läste också en artikel av Ted Chiang, sci fi-författare, där han jämförde ChatGPT med en blek kopia, en pixlad jpg-bild av internet. När du googlar så får du direkta svar, men ChatGPT ger inte raka fakta, utan en suddig version. Det är en intressant tanke, men jag tycker inte riktigt att analogin funkar. Kanske är det mer ett högupplöst foto där alla pixlar har bytt plats så bilden är oigenkännlig, men istället följer någon ny logik? ChatGPT har skrapat internet på information och besvarar frågan den ställts utgående ifrån vad den tolkar som sannolikt. Resultatet blir alltså något som låter korrekt, men som inte nödvändigtvis är fakta. Om du ber den skriva en akademisk artikel så kommer 99 procent av hänvisningarna att vara påhittade.

K: Den gör alltså inte hänvisningsarbetet, utan kopierar in olika referenser?

H: Inte ens att den kopierar, den interpolerar,- alltså samlar information och kombinerar den till något nytt. När den hänvisar tar den ett vanligt förnamn hos forskare inom fältet, ett efternamn, och skapar en titel som låter bra och sannolik. Men det är min poäng, den är inte till för att producera fakta, och om man tror att den kan skriva en akademisk artikel så har man missförstått syftet. Däremot om man vill ha ett abstract av en artikel, så kan den ofta ge en riktigt bra råversion eftersom man bara ber den utgå från en enda text. ChatGPT kan också ge nya idéer och uppslag till uppgifter att använda i undervisningen.

K: Datorer och mjukvara har överlag använts för att förenkla och förändra skrivprocessen, till exempel att man kan flytta om text på ett helt annat sätt än skrivmaskinen tillät, att referenshanteringsprogram gör att man inte behöver klippa och klistra med källhänvisningar till leda, och så vidare. Men jag tänker att ju mer avancerade verktyg desto mer kunskap krävs. En chatbots text speglar en mer avancerad tankeprocess som kan vara svår att syna, oavsett om det är för att man inte förstår koden bakom eller för att koden är en affärshemlighet. När går vi från smidigt tekniskt hjälpmedel till att behöva kritiskt granska resultatet av det vi arbetar med?

Transparens saknas

H: Andra sidan av myntet var något som Chiang- också tog upp, att skrivande är en form av tänkande som kan vara produktivt i sig. När jag skriver måste jag hitta kärnan i min forskning, men ber jag en maskin att göra det åt mig så går jag miste om den processen.

K: Apropå den tänkande processen och människans säregna geni så tror jag vi måste komma in på upphovsrätt nu. ChatGPT bygger ju på information som är skrapad på det som finns tillgängligt på internet. Det kan vara svårt att få insyn i exakt vilken data som ligger till grund för chatbotens svar eftersom transparens saknas. Använder den upphovsrättsskyddat material eller inte och vad kan det innebära?

H: Med DALL-E och andra program som genererar konst så har det blivit diskussion på -Deviantart där amatörkonstnärer delar sina verk. Många är upprörda över att DALL-E använder deras bilder som källa. Jag funderar ändå på varför detta är mer kränkande än att en mänsklig konstnär tittar på 100 illustrationer på Deviantart och tecknar något inspirerat av det. När vi människor skapar, så har vi ju också ”träningsdata”, alltså all vår samlade kunskap, böcker vi läst, konst vi sett. Det blir vår korpus, ur vilken vi skapar. Är det egentligen så annorlunda?

K: Sen kan man fråga sig att om man skapat ett verk med hjälp av en AI utifrån ens egen instruktion, är det man själv eller AI:n som är konstnären?

H: Det är klart att det är ett annat slags hantverk, då handlar det om konceptualiserande, som ju är vanligt inom samtidskonst och inte kan eller bör jämföras med traditionell bildkonst.

Människolik intelligens

K: Jag läste nyss en artikel där det talades om att e-sport kommer bli en ny marknad i framtiden för att det är alltid intressant att se vad människor kan göra, var människors gränser går. Att se en dator spela samma spel är inte intressant. Om man närmar sig ChatGPT och DALL-E med samma tankesätt finns inget hot mot ”traditionell” konst, eftersom människor alltid kommer att vara intresserade av vad andra människor tänker och gör. Jag såg också att Nick Cave hade rasat mot ChatGPT:s imitationer av hans låttexter. Det är klart att ChatGPT kan skriva texter i samma stil som Nick Cave men frågan är om det är intressant då han har en hel kulturell kontext kring sig. Det är kanske snarare den som gör texterna intressanta.

H: Hm, ja kanske. Samtidigt så tror jag att vi i allmänhet mer ifrågasätter den romantiska bilden av konstnärsgeniet, och det är kanske bara bra. Men jag måste åter påpeka ChatGPT:s funktion. Du hör det på namnet, det är en chatbot, en konversationsrobot, inte en Nick-Cave-sångtext-skrivar-bot. Den är inte skapt för att skriva sångtexter i någons stil, och då är outputen också i enlighet mer detta. Jag analyserar just nu ett verk av poeten Johannes Heldén- där han har skapat en textgenerator som imiterar honom – en Heldén-poesi-skrivar-bot om man så vill. Den gjordes redan 2014 och är mycket bättre på att imitera Heldén än ChatGPT är på att härma någon alls.

K: Finns det inte något häftigt i att man har en så pass distinkt stil att den går att imitera? Hos Heldén finns en nyfikenhet, ”hur blir jag i den digitala dimensionen, hur återskapas jag i en algoritm, vad är min roll i det?” Det är roligare att närma sig AI med nyfikenhet än med skepsis.

H: Ja, eller hur. Sen tycker jag hela benämningen artificiell intelligens är intressant, det som ju menas med ”intelligens” här är människolik. Samtidigt värderas logisk-matematisk intelligens högt hos människor, men hos en dator räknas det inte ens som intelligens. En räkne-maskin är inte AI, men den kan göra uträkningar som den smartaste matematiker aldrig skulle klara av. Alltså: en intelligent människa är så datorlik som möjligt, och en intelligent dator är så människolik som möjligt?

K: Ja, och ändå tänker man sig att ChatGPT ska kunna svara på allt. När jag har ett samtal med en människa så väntar jag mig inte att den ska kunna svara på allt. Så skulle man verkligen antropomorfisera så skulle man också inse att det finns begränsningar, på samma sätt som att jag inte väntar mig att du ska ha alla svar på mina frågor. Nåja, med dig gör jag det i och för sig …

H: Fast även om en människa inte alltid ger bra svar, eller ens förstår frågan, så förstår hon kontext på ett annat sätt än en robot. Den är programmerad att lösa en uppgift, som att samtala med dig eller köra ut mat åt dig, och den kan inte förstå och anpassa sig till situationen som en människa gör. Men det har bara börjat. Nu har ju en uppdaterad modell har utkommit, GPT-4, som är mycket mer avancerad än GPT-3 som ChatGPT är gjord på. Och Microsofts nya Bing-sökmotor är som en kombination av Google och ChatGPT. Det kommer att ske massor under den närmsta tiden. N

Länkar:

ChatGPT Is a Blurry JPEG of the Web

Per Gudmundson: Svensk AI får läsa på Flashback i stället för KB

Tre frågor om: Därför är e-sport ett framtidsyrke

Artikeln är baserad på en diskussion mellan Karolina Andersdotter och Hilda Forss. ChatGPT har använts som verktyg för redigering samt rubrik- och ingressättning.

Karolina Andersdotter är doktorand i informationsvetenskap med fokus på integritet och yttrandefrihet i informationssamhället.

Hilda Forss är grafisk designer och doktorand i nordisk litteratur med fokus på digital poesi.

1 kommentar

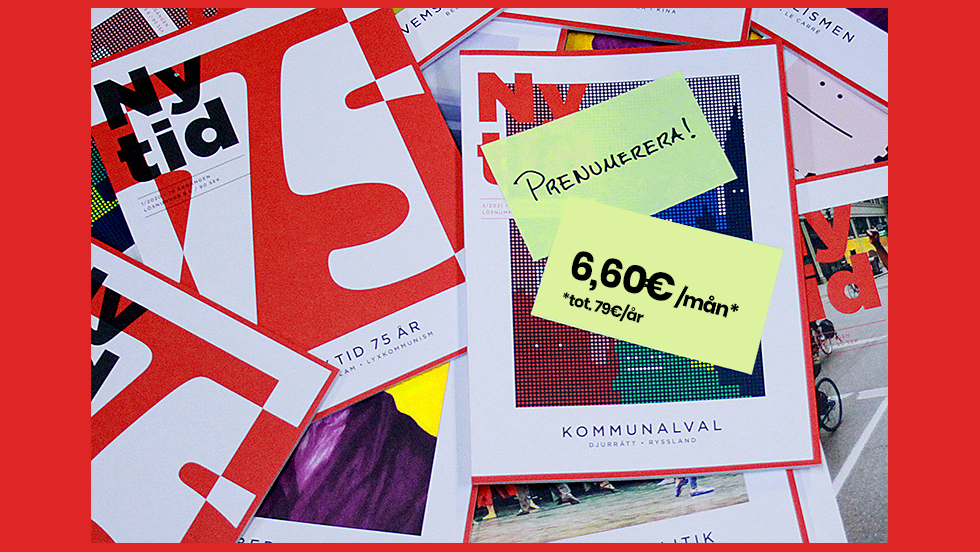

[…] DALL-E (or really mainly about challenges and opportunities in art and society brought on by AI) was published in Ny tid. It’s an interesting mix of our perspectives as researchers in information studies and […]